C’est précisément la promesse de GNoME, une initiative spectaculaire de Google DeepMind. Imaginez une IA capable non pas de discuter, mais de prédire l’existence et la stabilité de millions de nouveaux matériaux, accélérant potentiellement des décennies de recherche en quelques mois. Elle ne se contente pas de chercher une aiguille dans une botte de foin ; elle nous dessine la carte de toutes les bottes de foin de l’univers et nous indique où les aiguilles les plus prometteuses se cachent.

Dans cet article, nous allons enfiler nos lunettes de protection pour découvrir ensemble cette révolution silencieuse. Oui, car GNoMe n’est pas une IA Grand Public, mais elle est tellement extraordinaire, et elle joue (et jouera) un rôle tellement important pour nous (les Humains), que je ne pouvais pas ne pas vous en parler dans cette série. Elle fait partie de ces IA qui œuvrent dans l’ombre, sans qu’on le sache, sans l’effet WoW d’un ChatGPT livré au grand public, mais avec des effets et des bénéfices bien réels dans notre vie de tous les jours.

Découvrons ensemble son histoire, on va approcher (modestement) son fonctionnement avec une métaphore simple et voir quelles sont ses applications concrètes qui dessinent déjà le futur. Préparez-vous, nous partons à la découverte de GNoME, l’architecte des matériaux de demain.

La carte d’identité de GNoME

Voici les informations essentielles sur notre IA du jour, pour faire rapidement connaissance.

- Nom complet : GNoME (Graph Networks for Materials Exploration)

- Créateur : Google DeepMind

- Date de lancement officielle : Novembre 2023 (publication dans la revue Nature1)

- Type d’IA : Modèle prédictif basé sur des réseaux neuronaux de graphes (Graph Neural Networks – GNN).

- Modèle de tarification : Accès totalement libre et gratuit aux données. Les découvertes de GNoME sont intégrées à la base de données publique du Materials Project.

- Langues supportées : L’interface et les données sont principalement en anglais, le langage universel de la recherche scientifique.

Ce qui est extraordinaire dans l’histoire de GNoME, c’est son ouverture. Plutôt que de garder ses trésors pour elle, Google DeepMind a choisi de les offrir à la communauté scientifique mondiale. C’est un peu comme découvrir une carte au trésor et la partager avec tous les explorateurs du monde.

Il était une fois… L’épopée GNoME

L’histoire de GNoME c’est la convergence de deux courants puissants : une décennie de collecte de données patiente et une avancée fulgurante dans le domaine de l’intelligence artificielle.

L’acte I : La grande bibliothèque des matériaux

Pour comprendre GNoME, il faut d’abord voyager en 2011. Cette année-là, Kristin Persson, une chercheuse visionnaire du Lawrence Berkeley National Laboratory, lance le Materials Project. Son idée ? Créer une sorte de Wikipedia des matériaux, une base de données open-source répertoriant les propriétés des composés connus, calculées grâce à la puissance des supercalculateurs. Pendant plus de dix ans, cette « bibliothèque » s’est enrichie, devenant une référence incontournable pour les scientifiques du monde entier, mais la découverte restait un processus lent, basé sur des calculs intensifs. On ajoutait des livres à la bibliothèque, mais on ne savait pas encore comment écrire de nouvelles histoires.

L’acte II : L’arrivée des architectes de l’IA

Pendant ce temps, à Londres, une autre révolution est en marche. DeepMind, le laboratoire d’IA de Google, fait des merveilles. Après avoir battu les meilleurs joueurs du monde au jeu de Go avec AlphaGo et résolu le problème du repliement des protéines avec AlphaFold, l’équipe dirigée par Ekin Dogus Cubuk se tourne vers un nouveau défi : la science des matériaux. Leur constat est simple : l’humanité ne connaît qu’une infime fraction des matériaux stables possibles, quelques dizaines de milliers tout au plus. La méthode traditionnelle, mélange d’expérimentation et de calculs, est un goulot d’étranglement : c’est beaucoup, beaucoup trop long.

L’équipe de DeepMind se demande alors : et si on pouvait prédire la stabilité d’un matériau avant même d’essayer de le synthétiser ? Ils se tournent alors vers une technologie prometteuse : les réseaux neuronaux de graphes (GNN). L’idée est de représenter les structures atomiques comme un réseau, et de laisser l’IA apprendre les règles qui gouvernent leur stabilité.

L’acte III : Le pari de l’apprentissage actif

Les débuts sont difficiles. Les premiers modèles, entraînés en 2018 sur les données du Materials Project, sont décevants. Le taux de réussite pour prédire correctement une structure est à peine de 5%. C’est là qu’intervient le coup de génie : l’apprentissage actif. Au lieu de simplement entraîner l’IA, ils créent une boucle. GNoME fait des prédictions. Les plus prometteuses sont alors vérifiées par des calculs de simulation quantique très précis (la DFT). Les résultats de ces vérifications, qu’ils soient bons ou mauvais, sont réinjectés dans GNoME comme de nouvelles données d’entraînement.

Tour après tour, l’IA s’affine. Elle apprend de ses erreurs, corrige ses intuitions. Le taux de réussite grimpe en flèche, passant de 5% à plus de 80%. Le système devient non seulement précis, mais aussi incroyablement rapide.

En novembre 2023, c’est la consécration. L’annonce, publiée dans la prestigieuse revue Nature, a l’effet d’une bombe : GNoME a découvert 2,2 millions de nouvelles structures cristallines, dont 380 000 sont considérées comme les plus stables et donc les plus prometteuses pour des applications technologiques. En quelques mois, Google DeepMind venait de produire l’équivalent de près de 800 ans de recherche humaine. La quête de l’alchimiste venait de passer à l’ère de l’intelligence artificielle.

Comment ça marche ?

Tenter de comprendre les mécanismes profonds de GNoME peut sembler intimidant. Mais n’ayez crainte, nul besoin d’un doctorat en physique quantique. Utilisons une analogie pour rendre tout cela limpide.

Niveau 1 – Vue d’ensemble : L’IA, maître d’un LEGO cosmique

Imaginez que l’univers des matériaux est une boîte de LEGO absolument gigantesque contenant des milliards de briques de 118 types différents : les atomes du tableau périodique. Votre mission est de construire des structures solides et stables.

Pendant des siècles, les scientifiques ont procédé comme nous : on prend des briques, on essaie de les assembler, on regarde si ça tient. Parfois ça marche, souvent ça s’écroule. C’est long et fastidieux.

GNoME, c’est le Maître Constructeur de LEGO ultime. Il n’assemble pas les briques au hasard. Grâce à son entraînement, il a développé une intuition quasi parfaite des « règles d’assemblage » cosmiques.

- La connaissance des briques : GNoME connaît chaque atome (chaque brique LEGO) et la manière dont il aime se lier aux autres (les petits picots sur les briques).

- La prédiction de la structure : Quand on lui propose une recette (par exemple, « deux atomes d’hydrogène pour un d’oxygène »), il ne se contente pas de les coller ensemble. Il visualise la structure tridimensionnelle la plus probable et calcule son « énergie de formation ». C’est un peu comme s’il évaluait la solidité de la construction avant même de la bâtir. Une énergie basse signifie une structure très stable, comme une pyramide de LEGO bien solide. Une énergie haute signifie un assemblage bancal, prêt à s’effondrer.

- La génération de nouvelles idées : GNoME ne fait pas que vérifier nos idées. Il est aussi créatif ! Il peut proposer de lui-même des millions de nouvelles combinaisons d’atomes, des « recettes » inédites, et prédire immédiatement si elles formeront un matériau stable.

En résumé, lorsque les scientifiques utilisent GNoME, ils ne demandent pas à l’IA de faire le travail à leur place, mais de leur fournir un catalogue quasi infini de plans de construction viables, leur évitant de perdre du temps sur des impasses.

Niveau 2 – Sous le capot : Les secrets de l’architecte

Pour ceux qui veulent jeter un œil dans la salle des machines, voici les trois concepts clés qui font la puissance de GNoME, expliqués simplement.

- Les Réseaux Neuronaux de Graphes (GNN) : C’est le cerveau de l’opération. Un matériau cristallin, c’est un arrangement régulier d’atomes connectés par des liaisons chimiques. Un GNN est parfait pour ça : il représente la structure comme un réseau social. Les atomes sont les personnes (les nœuds) et les liaisons chimiques sont leurs amitiés (les arêtes). Le GNN analyse le « quartier » de chaque atome – qui sont ses voisins, à quelle distance – pour comprendre son état et, par extension, la stabilité de toute la « communauté » d’atomes.

- L’Apprentissage Actif (Active Learning) : C’est la méthode d’entraînement qui a tout changé. Imaginez un étudiant en médecine. Au lieu de juste lire des livres (entraînement passif), il va voir de vrais patients, pose un diagnostic, et un médecin senior lui dit s’il a raison ou tort (apprentissage actif). GNoME fait pareil : il fait une prédiction de stabilité. Cette prédiction est ensuite vérifiée par une méthode de calcul ultra-précise, la DFT, qui joue le rôle du « médecin senior ». La réponse de la DFT (stable/pas stable) est utilisée pour corriger et améliorer le modèle de GNoME pour la prochaine fois. C’est cette boucle de rétroaction qui l’a rendu si performant.

- La Théorie Fonctionnelle de la Densité (DFT) : C’est l’arbitre, la source de vérité. La DFT est une méthode issue de la mécanique quantique qui permet de calculer avec une grande précision l’énergie d’une structure atomique, et donc sa stabilité. Ces calculs sont très justes, mais aussi très lents. GNoME quant à lui, est des centaines de milliers de fois plus rapide que la DFT. L’astuce est donc d’utiliser la lente et précise DFT pour entraîner la rapide et prédictive GNoME. C’est le mariage parfait entre la vitesse de l’IA et la rigueur de la physique fondamentale.

Concurrence et positionnement

GNoME n’est pas arrivé dans un vide. Il s’inscrit dans un écosystème de la découverte de matériaux qui existe depuis des années.

- Les « Collaborateurs » : Le principal « concurrent » de GNoME est en réalité son plus grand partenaire : le Materials Project. GNoME a été entraîné sur ses données et, en retour, verse ses propres découvertes dans sa base de données. On peut aussi citer d’autres bases de données comme l’OQMD (Open Quantum Materials Database) qui poursuivent des objectifs similaires de catalogage.

- Les Alternatives : D’autres approches computationnelles existent, mais aucune n’a atteint l’échelle et la précision de GNoME. Avant, la recherche se basait sur des criblages à haut débit utilisant uniquement la DFT, une approche bien plus lente et moins exploratoire.

Ce qui différencie radicalement GNoME, c’est sa capacité à généraliser et à explorer l’inconnu. Là où les méthodes traditionnelles peinaient, GNoME a excellé. Par exemple, il a réussi à prédire des matériaux stables contenant 5 éléments chimiques différents ou plus, alors même que ce type de matériau complexe avait été volontairement omis de son entraînement initial. C’est la marque d’une IA qui n’a pas seulement « appris par cœur », mais qui a véritablement compris les principes sous-jacents de la stabilité matérielle. Sa précision de plus de 80% et l’échelle de ses 2,2 millions de prédictions le placent dans une catégorie à part.

Points forts et cas d’usage

La force de GNoME ne réside pas seulement dans le nombre impressionnant de matériaux découverts, mais dans leur potentiel à résoudre certains des plus grands défis de notre époque. Voici quelques cas d’usage concrets.

Les points forts en un coup d’œil :

- Échelle sans précédent : A généré une quantité de données équivalente à 800 ans de recherche.

- Haute précision : Plus de 80% de ses prédictions de matériaux stables sont correctes.

- Validation expérimentale : Plus de 736 de ses prédictions ont déjà été synthétisées et confirmées en laboratoire par des équipes indépendantes.

- Open Access : Toutes les données des 380 000 matériaux les plus stables sont publiques, accélérant la recherche mondiale.

Cas d’usage : Mini-tutoriels pour chercheurs et curieux

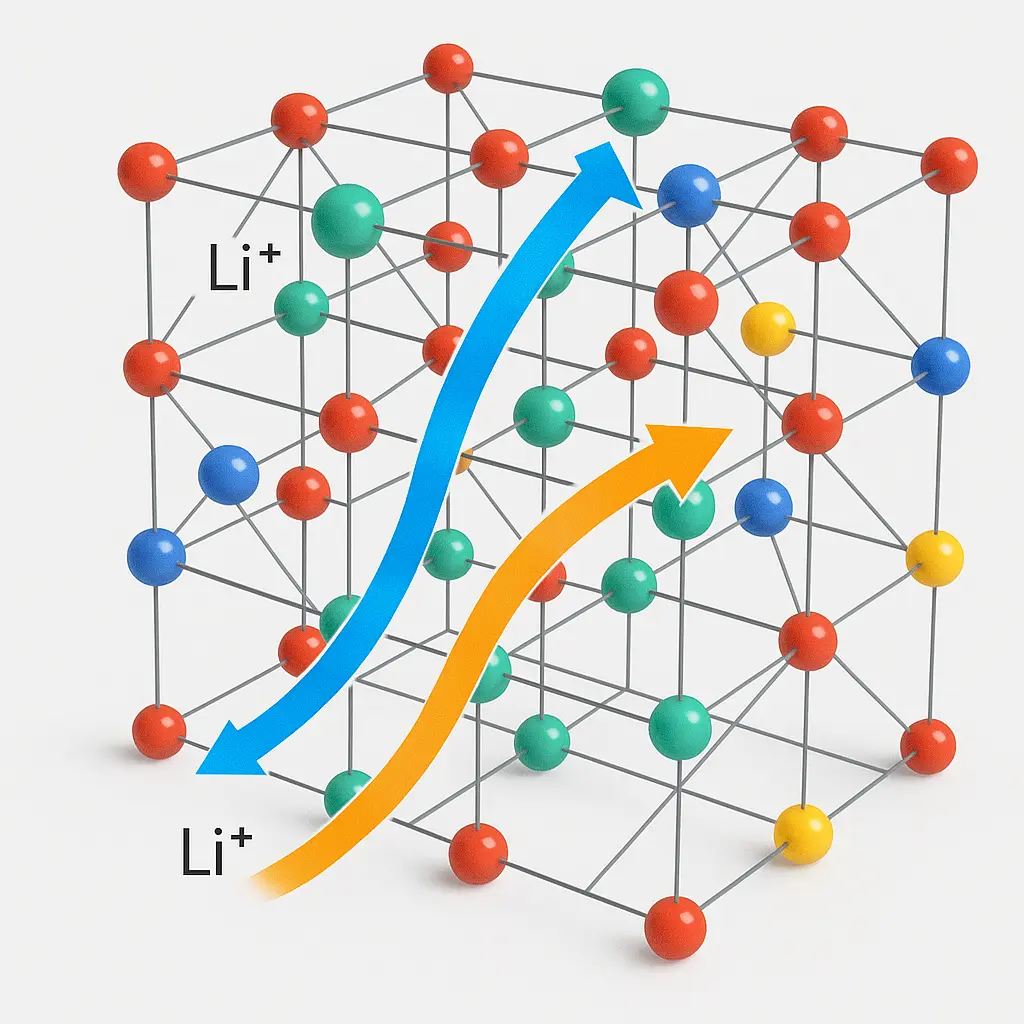

1. Trouver des matériaux pour les batteries du futur

- Objectif : Identifier de nouveaux conducteurs d’ions lithium pour des batteries plus sûres, plus durables et à recharge plus rapide.

- Niveau : Intermédiaire (pour un étudiant ou chercheur en matériaux)

- Pas-à-pas :

- Accéder aux données : Rendez-vous sur le portail du Materials Project, qui intègre les données de GNoME.

- Filtrer les candidats : Utilisez les outils de recherche pour filtrer la base de données par composition chimique (contenant du Lithium) et par propriété (conductivité ionique). GNoME a par exemple identifié 528 nouveaux conducteurs potentiels, multipliant par 25 le nombre de candidats connus.

- Analyser la stabilité : Triez les résultats par « énergie au-dessus de la coque convexe » (energy above hull). Plus cette valeur est proche de zéro, plus le matériau est stable et donc prometteur.

- Lancer la simulation : Les candidats les plus prometteurs peuvent ensuite faire l’objet de simulations DFT plus poussées ou de plans de synthèse expérimentale.

2. Concevoir le successeur du graphène

- Objectif : Découvrir de nouveaux matériaux bidimensionnels (2D) pour l’électronique de nouvelle génération.

- Niveau : Intermédiaire

- Pas-à-pas :

- Explorer les composés en couches : La base de données de GNoME contient 52 000 nouveaux composés en couches, similaires au graphène. Ce sont des matériaux qui peuvent potentiellement être « exfoliés » en feuilles d’un seul atome d’épaisseur.

- Rechercher des propriétés électroniques : Filtrez ces matériaux en fonction de leur « band gap » (bande interdite), une propriété qui détermine s’ils sont conducteurs, semi-conducteurs ou isolants.

- Identifier des candidats pour les puces : Un chercheur en micro-électronique peut ainsi repérer de nouveaux semi-conducteurs 2D potentiellement plus efficaces ou moins énergivores que le silicium pour les futures puces électroniques.

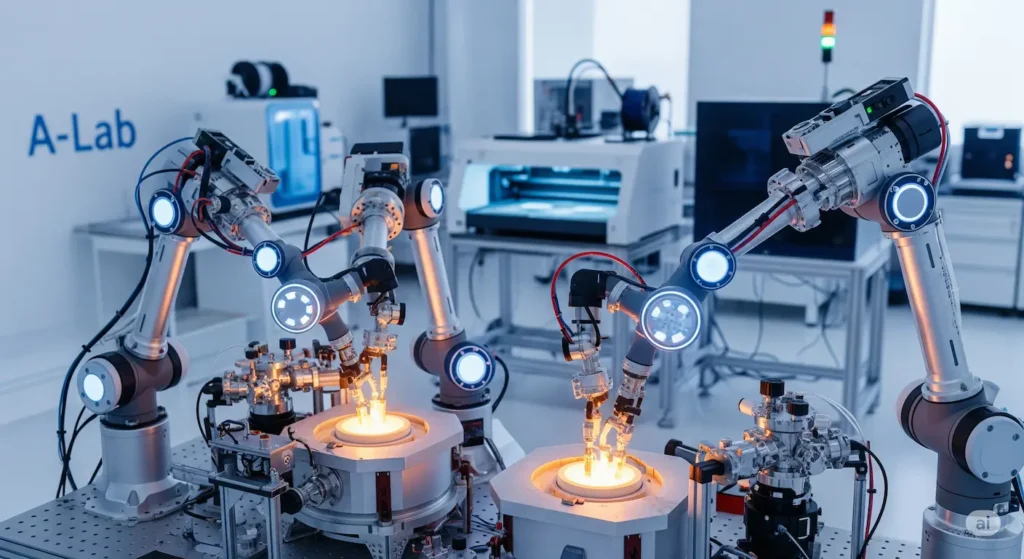

3. Accélérer la découverte avec des laboratoires autonomes

- Objectif : Valider expérimentalement et en un temps record les prédictions de GNoME.

- Niveau : Avancé (collaboration entre IA et robotique)

- Pas-à-pas :

- Sélection par l’IA : GNoME identifie une liste de dizaines de nouveaux matériaux prometteurs.

- Planification par l’IA : Un autre système d’IA analyse la littérature scientifique pour déterminer les « recettes » de synthèse les plus probables pour ces nouveaux matériaux.

- Synthèse robotisée : Ces recettes sont envoyées à un laboratoire robotisé, comme le A-Lab de Berkeley. Ce labo autonome a ainsi réussi à synthétiser 41 des 58 matériaux proposés par l’IA en seulement 17 jours. Ce processus de « boucle fermée » (découverte-synthèse) est l’avenir de la science des matériaux.

Image conceptuelle réalisée avec Gemini

Limites, risques et points faibles

Aussi révolutionnaire soit-il, GNoME n’est pas une baguette magique. Il est crucial pour nos scientifiques de comprendre ses limites pour l’utiliser à bon escient et garder un regard critique.

- La grande inconnue : la synthétisabilité : C’est LE point faible majeur. GNoME est excellent pour prédire si un matériau est stable d’un point de vue thermodynamique. Mais il ne dit rien sur la facilité à le fabriquer en laboratoire (sa synthétisabilité). Un matériau peut être parfaitement stable sur le papier, mais nécessiter des conditions de pression et de température extrêmes, ou des précurseurs si rares qu’il est impossible à créer en pratique. C’est comme avoir la recette d’un plat délicieux qui requerrait des larmes de licorne. C’est le prochain grand défi que DeepMind compte relever.

- Les angles morts techniques des GNN : La technologie des réseaux neuronaux de graphes, bien que puissante, a ses propres limites. Par exemple, les modèles actuels ont parfois du mal à capturer parfaitement les propriétés liées à la périodicité à longue distance, qui est l’essence même d’un cristal. C’est un peu comme comprendre les relations d’un groupe d’amis proches, mais avoir du mal à saisir la dynamique d’une ville entière. Des recherches sont en cours pour surmonter ces limitations inhérentes.

- Le risque de « l’effet réverbère » : En se concentrant sur les zones de « l’espace chimique » que l’IA juge les plus prometteuses, on risque de négliger des découvertes potentiellement révolutionnaires dans des zones considérées comme moins stables. L’IA nous guide vers la lumière, mais il pourrait y avoir des trésors cachés dans l’ombre. Il est donc essentiel que la créativité et l’intuition humaines continuent de jouer un rôle pour explorer les chemins de traverse.

Il est important de voir GNoME non pas comme un oracle infaillible, mais comme le plus puissant des assistants de recherche. Il déblaie le terrain, mais le travail de l’expérimentateur humain reste indispensable.

Conclusion

GNoME est un changement de paradigme pour la science des matériaux. En transformant une quête lente et fastidieuse en un processus de découverte à grande échelle, DeepMind ouvre une bibliothèque de possibilités matérielles que nous n’aurions jamais pu imaginer explorer de notre vivant. Des batteries plus performantes aux puces de demain, en passant par les technologies pour l’énergie propre, les applications potentielles touchent au cœur de nos défis sociétaux actuels.

L’outil n’est ni une fin en soi, ni une solution miracle. Il représente le point de départ d’innombrables nouvelles aventures scientifiques. Il nous rappelle que l’intelligence artificielle, dans sa forme la plus noble, n’est pas là pour remplacer l’humain, mais pour augmenter ses capacités, pour lui permettre de poser des questions plus audacieuses et d’explorer des frontières jusqu’ici inaccessibles.

La véritable question n’est plus « quels matériaux pouvons-nous découvrir ? », mais plutôt « parmi ces millions de nouvelles possibilités offertes par GNoME, lesquelles choisirons-nous de créer pour construire un avenir plus durable ? »

- Votre avis m’intéresse : Parmi toutes les applications possibles des matériaux découverts par GNoME (batteries, supraconducteurs, énergie solaire, etc.), laquelle vous semble la plus urgente ou la plus excitante ? Partagez votre opinion dans les commentaires !

- Le défi du curieux : Tentez l’expérience ! Allez sur le site du Materials Project et utilisez la recherche pour trouver un matériau contenant du Fer (Fe) et de l’Oxygène (O). Explorez sa structure 3D interactive. Vous mettez les pieds dans la plus grande bibliothèque de matériaux du monde !

Pour approfondir le sujet de GNoME :

- L’article officiel dans Nature : Pour les plus courageux, le papier de recherche original (en anglais).

- Le blog de Google DeepMind : Une excellente vulgarisation par les créateurs eux-mêmes.

- Le dépôt GitHub du projet : Pour ceux qui veulent voir le code et les données de plus près.

Dans le prochain article : nous allons partir explorer un autre pan de l’IA Générative, sans doute une des utilisations qui a été la plus impressionnante, la génération de code informatique. On part à la découverte de BOLT.NEW.

Abonnez-vous pour rien rater de mon actualité. Je vous donne rendez-vous dès demain pour ce nouvel article de la série 1 jour 1 IA !

Timeline des dates clés

- 2011 : Lancement du Materials Project au Lawrence Berkeley National Laboratory, posant les fondations de données pour la future recherche.

- 2018 : Début de l’entraînement des premiers modèles GNoME, en utilisant un jeu de données de 69 000 matériaux issus du Materials Project.

- Novembre 2023 : Annonce publique majeure et publication d’un article dans la revue Nature, révélant la découverte de 2,2 millions de nouveaux matériaux.

- 2023-2024 : La communauté scientifique mondiale s’empare des données. Des chercheurs externes valident et synthétisent indépendamment 736 des matériaux prédits par GNoME.

- Août 2024 : Le jeu de données public est étendu pour inclure plus de 520 000 matériaux, affinant encore la sélection des candidats les plus stables.

- La revue « Nature » est une publication scientifique généraliste de référence, fondée en 1869 par Joseph Norman Lockyer. Elle est publiée de manière hebdomadaire et est connue pour son comité de lecture rigoureux et son facteur d’impact élevé, ce qui en fait l’une des revues scientifiques les plus réputées au monde, aux côtés de la revue américaine Science. Nature couvre un large éventail de domaines scientifiques et publie des articles de recherche de haute qualité qui influencent les décideurs et les leaders d’opinion à travers le monde. Depuis les années 1990, elle a développé plusieurs revues satellites spécialisées pour répondre à la diversité et à la quantité croissante des recherches scientifiques. La revue est également reconnue pour son engagement envers l’accès libre aux contenus scientifiques, permettant à ses abonnés de partager des articles dans un format « lecture-seule ». ↩︎

Vous pouvez retrouver tous les termes techniques de cet article dans le glossaire disponible ici.

⚠️ Avertissement sur la mise à jour des informations

Cet article a été rédigé en juin 2025. Le domaine de l’intelligence artificielle évoluant extrêmement rapidement, certaines informations présentées peuvent ne plus être à jour au moment de votre lecture. Je vous invite à vérifier les dernières actualités et développements dans ce secteur.

🤖 Méthodologie de rédaction & rôle de l’IA

J’ai rédigé cet article avec l’assistance de plusieurs outils d’intelligence artificielle : Perplexity pour les recherches documentaires, Gemini pour la rédaction des sections techniques et leur vulgarisation, et ChatGPT pour la génération des images.

Cet article s’inscrit dans la série « 1 jour – 1 IA », une démarche qui poursuit un double objectif : rendre accessible l’univers des intelligences artificielles par des contenus pédagogiques de qualité, tout en démontrant qu’il est possible de maintenir un rythme de publication quotidien sans sacrifier sa vie professionnelle et familiale, grâce aux bons outils.

Cette approche collaborative entre humain et IA illustre parfaitement les nouvelles méthodes de création de contenu : Perplexity a alimenté mes recherches documentaires avec ses réponses sourcées, Gemini m’a accompagné dans la vulgarisation des concepts techniques les plus complexes, tandis que ChatGPT a donné vie aux illustrations visuelles. Mon rôle d’auteur s’est concentré sur la conception initiale, l’architecture narrative, la cohérence stylistique et les ajustements pour préserver ma voix éditoriale. Cette synergie représente environ 50% de travail humain et 50% d’assistance IA.